如何融合知识图谱与大语言模型?

目前,将 KG 融入 LLMs 的方法主要有几类:

- 知识图谱增强的检索增强生成 (KG-RAG): 这是目前最主流和实用的方法之一。其核心思想是在 LLM 生成回答前,先从 KG 中检索与问题相关的知识(实 …

如何融合知识图谱与大语言模型?

目前,将 KG 融入 LLMs 的方法主要有几类:

- 知识图谱增强的检索增强生成 (KG-RAG): 这是目前最主流和实用的方法之一。其核心思想是在 LLM 生成回答前,先从 KG 中检索与问题相关的知识(实体、关系、子图),并将这些知识作为上下文(Context)注入 Prompt,引导 LLM 生成更准确、更具知识性的回答。

- 知识图谱指导的预训练/微调: 在 LLM 的预训练或微调阶段,引入 KG 中的结构化知识,让模型在学习语言模式的同时,也学习事实和关系。

- 知识图谱引导的生成: 在 LLM 的解码生成阶段,利用 KG 对生成过程进行约束和引导,确保生成内容符合 KGs 中的事实。

微软 GraphRAG 与我的中文优化实践

在 KG-RAG 领域,微软开源的 GraphRAG 项目是一个值得关注的先进实践。GraphRAG 的核心思路是从非结构化的文本数据中自动构建知识图谱,然后利用这个图谱进行检索,为 LLM 提供高质量的上下文信息,从而提升问答、摘要等任务的效果。它特别适用于处理复杂、相互关联的私域文档。

然而,原始的 GraphRAG 主要面向英文环境。为了让中文用户也能方便地利用这一强大工具,我个人对 GraphRAG 进行了中文优化,并推出了开源项目:graphrag-Chinese-llm。

我主要做了以下工作:

- 适配中文处理流程: 针对中文分词、实体识别、关系抽取等环节进行了优化,使其能更好地处理中文文本,构建高质量的中文知识图谱。

- 集成中文 LLM 支持: 优化了与各类中文大语言模型(如智谱 GLM、通义千问、文心一言等)的对接,确保在中文环境下的流畅运行和良好效果。

- 易用性提升: 简化了配置和部署流程,让中文用户更容易上手。

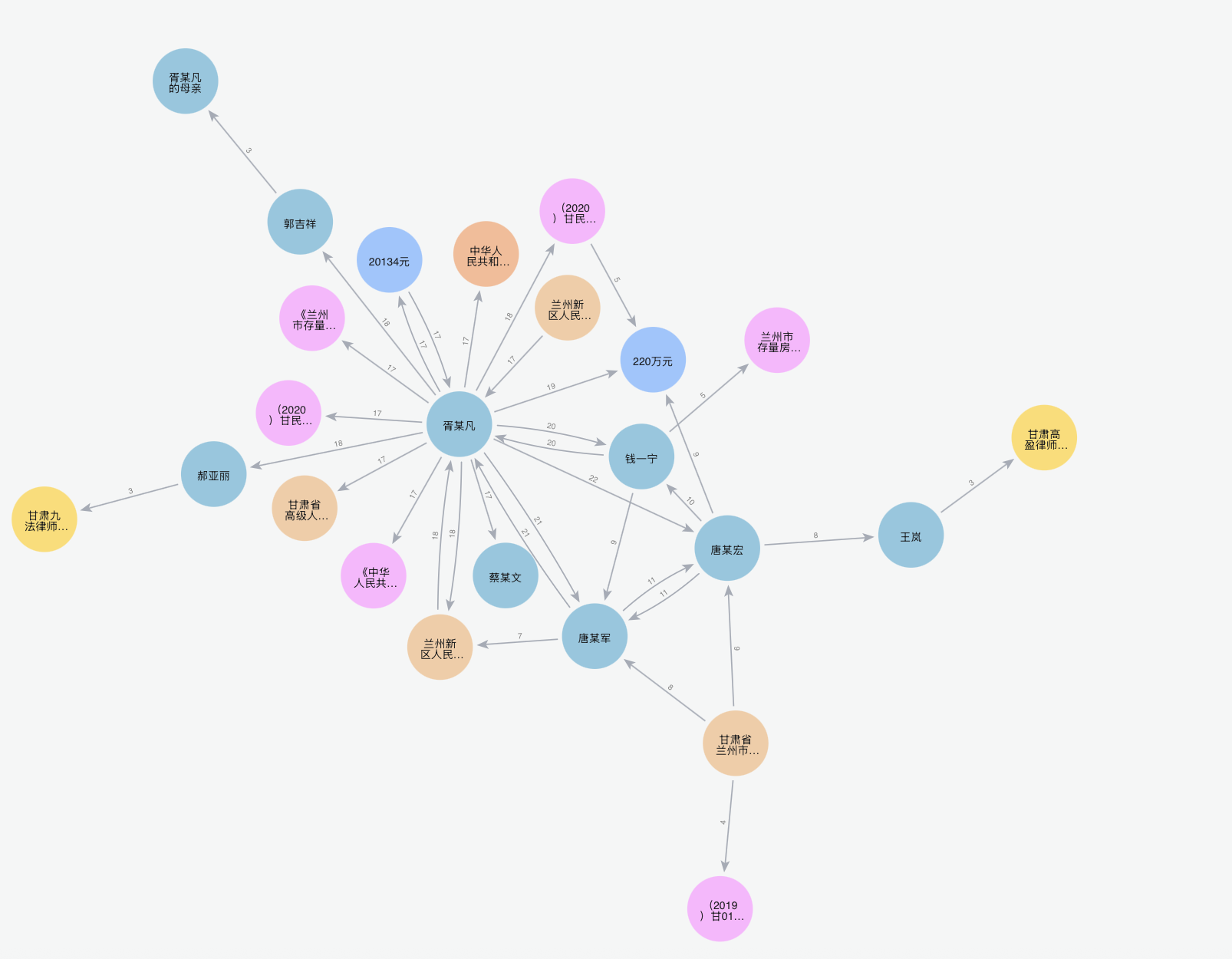

更令人期待的是,我正在为 graphrag-Chinese-llm 开发一套直观的可视化界面! 这套界面将允许用户:

- 可视化图谱构建过程: 直观展示从文本到知识图谱的抽取和构建流程。

- 交互式图谱探索: 方便地浏览、查询和分析生成的知识图谱。

- 可视化 RAG 流程: 展示检索到的相关知识以及 LLM 基于这些知识生成答案的过程,增强可解释性。

我相信,这套可视化界面将极大地降低使用门槛,让更多非专业用户也能体验和利用知识图谱增强 LLMs 的强大能力。

欢迎访问我的 GitHub 项目,体验中文优化的 GraphRAG: https://github.com/via007/graphrag-Chinese-llm

目前,中文优化部分已经开源,欢迎大家 Star、Fork、试用和贡献代码!可视化界面将在后续开发完善后择机开源,敬请期待!

面临的挑战与未来展望

尽管前景广阔,知识图谱增强 LLMs 的道路仍然面临挑战:

- 高质量知识图谱构建: 自动化构建大规模、高质量、领域自适应的知识图谱仍然是一个难题。

- 知识图谱的动态更新与维护: 如何高效地更新 KG 以反映现实世界的变化,并确保与 LLM 的协同,是一个持续的挑战。

- 深度融合与效率: 如何更深度、更高效地融合 KG 与 LLM,平衡知识注入带来的效果提升与计算开销。

- 标准化与互操作性: 不同来源、不同结构的知识图谱如何实现互操作,与不同的 LLM 顺畅对接。

未来,我们期待看到更智能的图谱自动构建技术、更高效的知识更新机制以及更深层次的 KG-LLM 融合模型。结合知识图谱的结构化推理能力和 LLMs 的泛化生成能力,有望将人工智能推向新的高度,在企业知识管理、智能问答、科研探索、内容创作等领域释放更大的价值。

结语

大语言模型与知识图谱的结合,是通往更强大、更可信赖 AI 的重要方向。通过融合结构化的知识,我们可以有效提升 LLMs 的事实性、推理能力和可解释性。我基于微软 GraphRAG 进行的中文优化和正在开发的可视化界面 (graphrag-Chinese-llm 项目),正是朝着这个方向迈出的实践一步。

我诚挚邀请您关注这个项目,共同探索知识图谱增强大语言模型的无限可能。欢迎试用、反馈、贡献,让我们一起构建更智能的 AI 未来!